Con miras a las elecciones presidenciales del próximo 16 de noviembre, el medio chileno Mala Espina lanzó un chatbot educativo diseñado para entrenar a las personas en la detección de afirmaciones engañosas, el análisis de contenidos virales y la búsqueda de fuentes confiables.

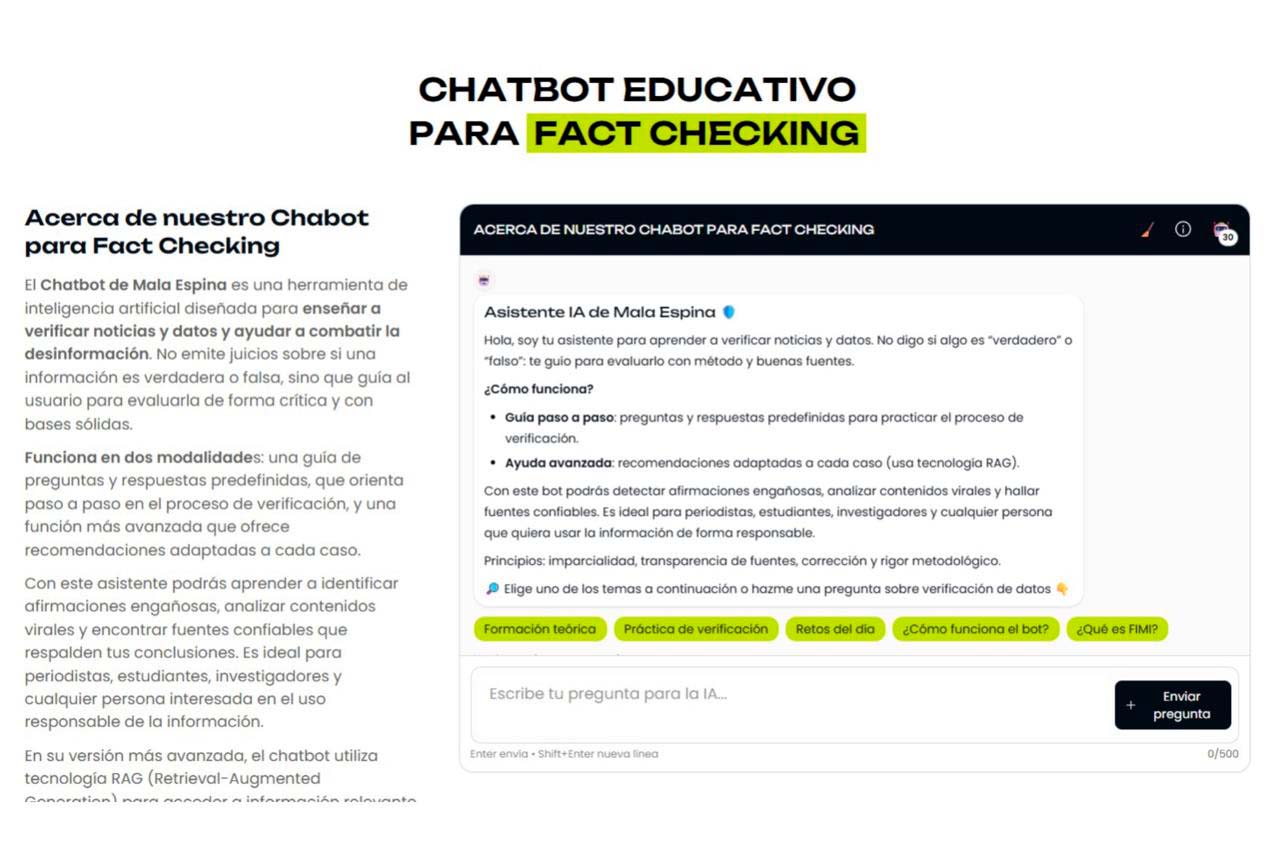

El asistente, disponible de forma gratuita en malaespinacheck.cl y con registro previo, ofrece dos modalidades de uso: una guía con preguntas y respuestas predefinidas —que incluye teoría, ejercicios prácticos de verificación y desafíos basados en la actualidad— y una opción más avanzada, que permite consultar a la inteligencia artificial y recibir recomendaciones personalizadas, con información contextual.

“El objetivo del chatbot es que la audiencia, principalmente estudiantes escolares y universitarios, pero también otros públicos, se empodere y tenga sus propias herramientas para frenar la desinformación”, subraya Tomás Martínez, fundador y director del sitio especializado en fact-checking.

En contextos electorales, la desinformación se intensifica. En los últimos años, el trabajo de los fact-checkers cobró un papel clave: la inteligencia artificial generativa facilita la creación de contenido falso o manipulado, y permite generar videos, imágenes o audios sintéticos con un alto grado de realismo, lo que dificulta identificar la veracidad y autenticidad de la información.

Esta herramienta forma parte del proyecto “Promoviendo información confiable y abordando la desinformación en América Latina”, liderado por la organización argentina Chequeado y financiado por la Unión Europea.

Aprender a verificar información con un asistente de IA

Martínez cuenta que el chatbot educativo se entrenó con información curada. “El material fue generado en base a modelos educativos de fact-checking”, precisa el periodista chileno y aclara: “El chatbot está diseñado solo para enseñar a verificar noticias o datos, no para hacer chequeos o responder otros temas”.

El bot de Mala Espina fue diseñado para ofrecer respuestas tanto guiadas como personalizadas. Tras registrarse, el usuario elige de qué manera interactuar con el contenido teórico y práctico que entrega el agente. Puede seleccionar distintos temas: formación teórica, práctica de verificación o retos del día. En cada uno, se desplegará un listado de subtemas.

Dentro de la teoría, se puede aprender qué es la desinformación, qué tipos de desinformación existen, qué es la desinformación viral y qué es la desinformación electoral. Asimismo, hay consejos para no caer en ese tipo de narrativas y cómo evitar estafas por WhatsApp.

En los ejercicios interactivos, en tanto, se pueden practicar procesos de verificación de imágenes, vídeos y textos, así como también detectar IA generativa.

Finalmente, el usuario pone a prueba todos los conocimientos anteriores de forma lúdica: el bot le ofrece retos basados en temas de actualidad.

La otra forma de interactuar con el chatbot es más conversacional: en vez de elegir un tema, directamente se le puede hacer una pregunta sobre verificación de datos.

En promedio, reciben entre 50 y 60 consultas diarias.

Aprovechar un modelo existe de IA para desarrollar un chatbot

Hacer un chatbot desde cero, o entrenar un modelo de lenguaje grande (LLM), puede ser muy costoso por los recursos que se deben implementar tanto para el entrenamiento, como para su puesta en producción.

Mala Espina tuvo en cuenta esos dos factores y decidió aprovechar un modelo ya existente —en este caso, la API de Chat GPT-4o Mini— para diseñar el asistente educativo. En concreto, adaptaron la forma en que responde entregando un contexto de conocimiento mediante tecnología RAG (Retrieval Augmented Generation) y aprovecharon un resumen contextual preparado para cada usuario mediante su WordPress, lo que facilita que pueda responder sobre temas específicos.

“No entrenamos un LLM desde cero; lo adaptamos y contextualizamos de forma apropiada con técnicas de recuperación de información, que nos permiten tener un producto de alta calidad, escalable y a un costo mucho más bajo del que hubiera significado, por ejemplo, hacer un fine tuning de un modelo ya existente”, explica Pablo Silva, a cargo del diseño, desarrollo e implementación del chatbot educativo.

El desarrollador de Mala Espina destaca que la implementación en el CMS que usa el medio fue “directa y natural”: “La API de OpenAI tiene un protocolo ya preparado para funcionar con PHP. Esto nos ahorró horas de desarrollo y nos permitió tener un producto funcional y escalable, sin necesidad de utilizar librerías como Langchain, por ejemplo”.

Información precisa y contextual, a menor costo y tiempo

La versión más avanzada del chatbot utiliza la metodología RAG para extraer información relevante, precisa y contextual.

“La elección de implementar un RAG se debe, principalmente, a sus costos asociados (que son muchos más bajos que realizar un fine-tuning o un entrenamiento de un LLM desde cero) y a que nos permite tener una IA especializada en temas específicos y vigente”, indica Silva.

Según el desarrollor web del equipo de Mala Espina, preparar y enriquecer la información del RAG es un proceso rápido, que no toma más de cinco o diez minutos. “Esto nos permite tener información actualizada para nuestro chatbot casi en tiempo real. Por el contrario, un proceso de entrenamiento o fine-tuning de un LLM puede tomar muchísimo más tiempo (dependiendo del proceso, puede demorar horas, días o semanas) a un costo mucho mayor”, resalta Silva.