Una investigación de Verificat ha detectado la proliferación de canales en YouTube que simulan estar gestionados por médicos especializados en envejecimiento, pero cuyos contenidos están generados con inteligencia artificial, sin que la mayoría de los vídeos indiquen su carácter sintético, pese a que las políticas de la plataforma obligan a hacerlo.

El análisis se ha centrado en 14 canales que aseguran haber sido creados en España y que, en conjunto, han publicado cerca de un millar de vídeos con 54 millones de visualizaciones y más de medio millón de seguidores. Según el estudio, el 74% de los vídeos no incluyen la etiqueta que indica que han sido generados con inteligencia artificial.

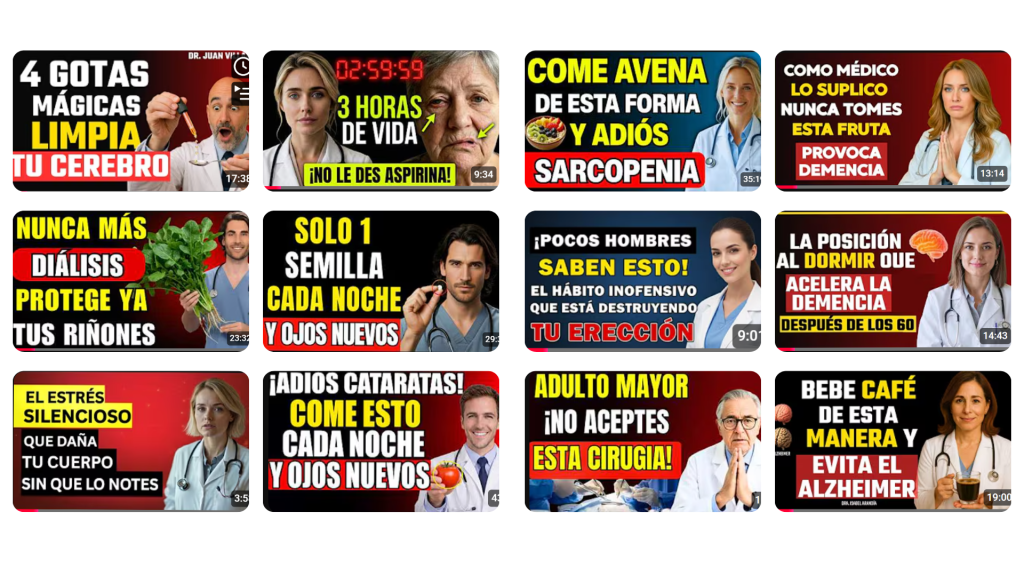

Los contenidos están dirigidos principalmente a personas mayores y presentan consejos sobre salud, alimentación o prevención de enfermedades sin base científica, incluyendo referencias a “alimentos milagrosos”, recomendaciones para evitar tratamientos médicos o advertencias contra vacunas y cirugías. Verificat señala que algunos de estos contenidos ya han sido desmentidos previamente.

Los perfiles analizados comparten características similares: presentan supuestos profesionales con bata blanca, utilizan avatares generados digitalmente y repiten estructuras narrativas, guiones y descripciones casi idénticas entre canales distintos. En varios casos, se han detectado incoherencias en los nombres de los supuestos médicos o elementos visuales con errores propios de contenidos generados por IA, como texto ilegible.

De los 962 vídeos analizados, solo el 26% incluía la etiqueta de “contenido alterado o sintético”, exigida por YouTube para materiales generados con inteligencia artificial. En ocho de los canales, entre el 80% y el 100% de los vídeos carecía de esta identificación.

Tras recibir la investigación el 11 de marzo de 2026, YouTube ha adoptado varias medidas: ha añadido etiquetas de IA a alrededor de 700 vídeos, ha cerrado uno de los canales por vulnerar las políticas de spam y prácticas engañosas, y ha retirado a otros del Programa de socios, impidiéndoles generar ingresos.

El fenómeno no se limita a España. Organizaciones europeas de verificación como Full Fact o Science Feedback han identificado prácticas similares en otros países, lo que apunta a una tendencia internacional en la que se utilizan deepfakes para simular expertos en salud.

La investigación también señala implicaciones regulatorias. La Ley de Servicios Digitales (DSA) de la Unión Europea obliga a las plataformas a identificar y mitigar riesgos sistémicos, incluidos los relacionados con la salud pública. Además, la normativa europea sobre inteligencia artificial prevé obligaciones de transparencia que exigirán identificar contenidos generados artificialmente.

Desde el ámbito médico, representantes del Colegio de Médicos de Barcelona recuerdan que el ejercicio profesional exige identificación verificable, incluyendo nombre y número de colegiado, elementos ausentes en los canales analizados. También advierten de que la mezcla de información veraz con afirmaciones falsas puede generar riesgos reales para la salud de los usuarios.

Todos los vídeos estudiados abordan cuestiones relacionadas con enfermedades frecuentes en edades avanzadas, como patologías cardiovasculares, diabetes o deterioro cognitivo, reforzando su atractivo para un público específico y aumentando el potencial impacto de la desinformación difundida.