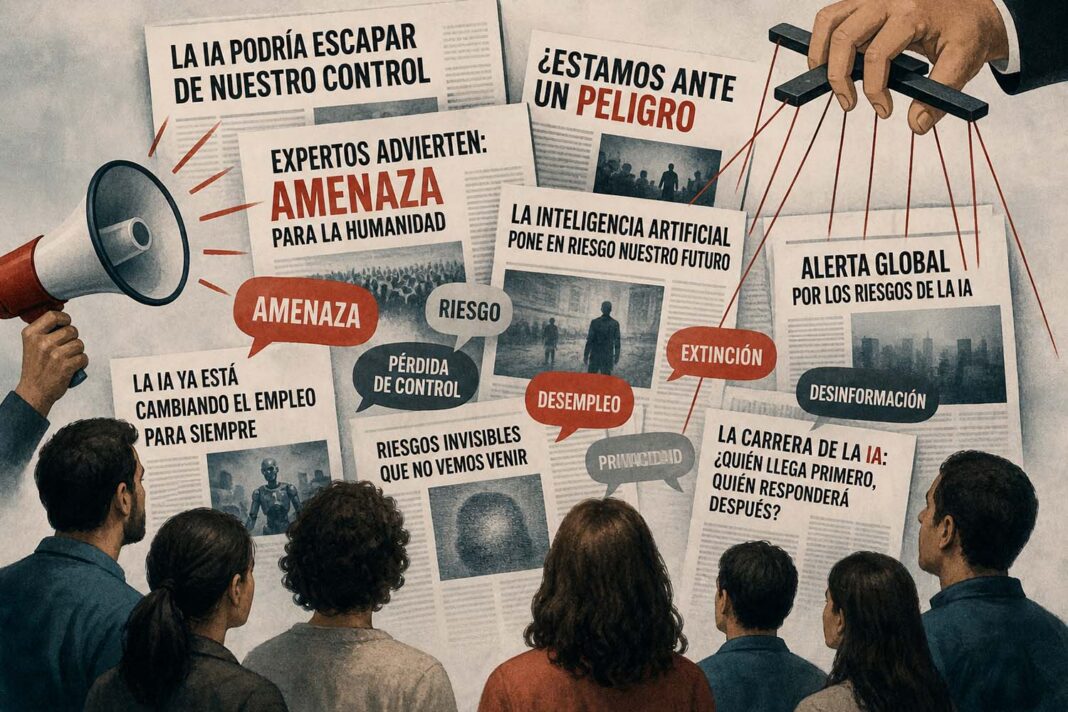

El riesgo, como constructo social, no constituye una realidad fija ni exclusivamente objetiva, sino una noción susceptible de ser visibilizada, atenuada, amplificada e, incluso, creada. En este proceso, los medios de comunicación desempeñan un papel central en la circulación pública de los riesgos, no siempre en calidad de agentes promotores autónomos, sino con frecuencia como intermediarios en la difusión de los intereses, marcos interpretativos y agendas de otros actores sociales, políticos o económicos.

En el ámbito tecnológico, esta dinámica se ha manifestado de forma especialmente significativa: la inteligencia artificial representa uno de los primeros campos en los que, de manera simultánea a la exaltación de sus potencialidades transformadoras, se ha articulado un discurso persistente y sistemático en torno a sus posibles riesgos. En un escenario caracterizado por la incertidumbre estructural y la aceleración del cambio sociotécnico, los medios de comunicación continúan ocupando una posición estratégica como instancias de mediación simbólica llamadas a orientar la interpretación pública desde criterios de rigor, honestidad informativa y veracidad.

Una investigación reciente que hemos desarrollado desvela las tendencias y actores en la construcción de ese relato de riesgo en la prensa española. Cuando ChatGPT irrumpió en el debate público a finales de 2022, los medios de comunicación se llenaron de titulares sobre inteligencia artificial. Pero ¿qué riesgos se estaban contando realmente? ¿Y quién los contaba? Nuestro estudio analizó 2.705 textos periodísticos publicados en seis grandes periódicos digitales nacionales españoles durante el primer año tras el lanzamiento. El objetivo era identificar qué tipos de riesgos asociados a la inteligencia artificial aparecían en los medios de comunicación y, sobre todo, qué voces y actores eran las que configuraban ese relato.

Los riesgos más representados en los medios

Lo más llamativo fue la escala de los miedos que dominaban el discurso. El riesgo más frecuente en los textos analizados fue el que afecta a la civilización y la humanidad en su conjunto -escenarios de extinción, pérdida de control sobre la IA, amenazas existenciales, con casi un 28% de las menciones. Muy cerca, con un 26,5%, aparecían los riesgos para los individuos: privacidad, manipulación, desinformación, impacto en el empleo.

Por detrás quedaban los riesgos económicos (17,9%), los que afectan a grupos sociales específicos (10,4%), los institucionales (8,6%) y los relacionados con infraestructuras tecnológicas críticas (8%). El medio ambiente, sorprendentemente, apenas rozaba el 1%.

Este patrón revela algo significativo: la prensa española tendió a enmarcar la inteligencia artificial en términos de grandes catástrofes globales o de afectación individual, pero prestó mucha menos atención a riesgos más concretos, sistémicos o colectivos, como los que recaen sobre comunidades vulnerables o sobre las propias instituciones democráticas. El riesgo se construía, al mismo tiempo, como un riesgo social que aleja al ciudadano de la acción.

¿Quiénes enuncian el riesgo?

Tan revelador como el qué es el quién. Al clasificar las voces que aparecían en los textos, el estudio constata que el debate público sobre la IA en España está protagonizado, fundamentalmente, por tres actores: los propios medios y periodistas (28,6%), el gobierno y los reguladores (25,6%) y las empresas tecnológicas y el sector privado (21,5%). La sociedad civil, las ONG y los ciudadanos, en cambio, están llamativamente ausentes. El relato sobre los riesgos de la inteligencia artificial se construye, en gran medida, desde las instituciones, las redacciones y las propias compañías que desarrollan estas tecnologías.

La instrumentalización del riesgo

El estudio deja entrever indicios de que algunas de las narrativas sobre riesgos existenciales de la IA podrían estar siendo promovidas estratégicamente por actores empresariales o tecnológicos para desviar la atención de los riesgos más inmediatos y concretos, y para dificultar una regulación más estricta en el corto plazo.

Presentar la inteligencia artificial como una fuerza abstracta, casi inevitable e incontrolable, tiene un efecto colateral muy conveniente para quienes la desarrollan: diluye la responsabilidad humana y empresarial. Si el riesgo es “la humanidad entera”, nadie en particular tiene que rendir cuentas. Esto no significa que los riesgos existenciales sean falsos ni que no merezcan atención. Significa que conviene leer el debate público con más espíritu crítico, preguntando siempre quién habla, desde dónde habla y qué intereses puede tener al hacerlo.

El rol del periodismo

El periodismo tiene un papel fundamental en la forma en que la sociedad percibe y evalúa los riesgos tecnológicos. Pero ese papel solo puede ejercerse bien si se amplía el círculo de voces, si se incorporan perspectivas ciudadanas y se equilibra la cobertura de los grandes relatos apocalípticos con la atención a los daños más cotidianos y verificables que la IA ya está causando hoy.

El debate sobre la inteligencia artificial es demasiado importante como para dejarlo solo en manos de fuentes oficiales. La ciudadanía también tiene algo que decir. Y los periodistas, la responsabilidad de promover el debate.

El periodismo tiene un papel fundamental en la forma en que la sociedad percibe y evalúa los riesgos tecnológicos. No solo informa sobre ellos: también contribuye a jerarquizarlos, interpretarlos y hacerlos visibles en el espacio público.

Esa tarea exige ampliar el repertorio de voces presentes en la cobertura, incorporando perspectivas ciudadanas, académicas y sociales diversas. También requiere equilibrar los grandes relatos sobre amenazas futuras con una atención sostenida a los daños inmediatos, concretos y verificables que la inteligencia artificial ya está generando.

El debate sobre la inteligencia artificial es demasiado importante para quedar restringido a empresas tecnológicas, expertos o fuentes oficiales. La ciudadanía también debe formar parte de esa conversación. Y el periodismo tiene la responsabilidad democrática de abrirla, enriquecerla y someterla a escrutinio crítico.

*Berta García-Orosa forma parte de IBERPERIA, la Red Iberoamericana de Investigación en Periodismo e Inteligencia Artificial.