El área de I+D de The New York Times ha intensificado el trabajo con la redacción para identificar áreas en las que la realidad mixta (MR por sus siglas en inglés) pueda ayudar a los reporteros a capturar y presentar las noticias. La realidad mixta es la combinación de realidad virtual y realidad aumentada.

The New York Times ya comenzó a publicar historias de realidad mixta para dispositivos móviles en 2018, ofreciendo a los lectores una nueva forma de sumergirse en el periodismo. Varias historias de realidad aumentada han ofrecido desde entonces a los lectores la posibilidad de ver, por ejemplo, la moda icónica de David Bowie exhibida en su propio espacio, volver a visitar la misión Apolo 11 en primera persona o explorar muchas otras historias de manera inmersiva.

Ahora, en concreto, como continuación de esa investigación, The NYT está trabajando para crear herramientas que aceleren la recopilación de información en noticias de última hora, crear instantáneamente modelos 3D de espacios en lugar de tener que dibujarlos manualmente o ayudar a los reporteros a reconstruir un evento noticioso al combinar imágenes 2D en entornos 3D.

Estos son algunos de los campos en los que está trabajando específicamente, dentro de esa línea de ayudar a mejorar la última hora informativa:

Hardware para tomar notas recreando un entorno real

Tomar notas es el primer bloque de construcción del periodismo. El equipo de I+D estaba interesado en explorar si los sensores espaciales integrados en los auriculares podrían ayudar a los reporteros a analizar y anotar un entorno. El equipo ha desarrollado dos prototipos de MR funcionales, que responden a las peticiones de los redactores: los reporteros estaban interesados en una UX que funcionara bien en situaciones de alta velocidad y simplificara los procesos que actualmente se realizan a mano.

Una primera versión del prototipo permitía a los reporteros usar comandos de voz y anotaciones de voz a texto para dejar notas en el espacio, y luego se ha ido mejorando. Con esta innovación es posible capturar el entorno y dejar anotaciones en él. Todo queda grabado.

El equipo experimentó con una variedad de tipos de medios para notas, incluidos texto, fotos, video, audio y notas de voz del reportero. En general, los reporteros encontraron que la toma de notas espaciales era intuitiva y potencialmente una buena opción para las noticias de última hora y de ritmo rápido.

Optimizar los informes de campo

Ser lo más fidedignos posible en la reconstrucción de espacios es una de las metas que se plantearon. En este caso, la investigación combinó varios métodos de documentación, explorando las muchas capacidades proporcionadas por los sensores de los auriculares. Un visor escanea constantemente el entorno, capturando automáticamente una gran cantidad de datos a alta frecuencia, incluida la posición de la cámara, las medidas de rotación y la información de la malla 3D.

Los sensores siempre activos permiten a los reporteros recopilar información mientras se mueven por un espacio. Estos datos se guardan en la nube y están disponibles para que puedan consultarlos en cualquier momento en el futuro.

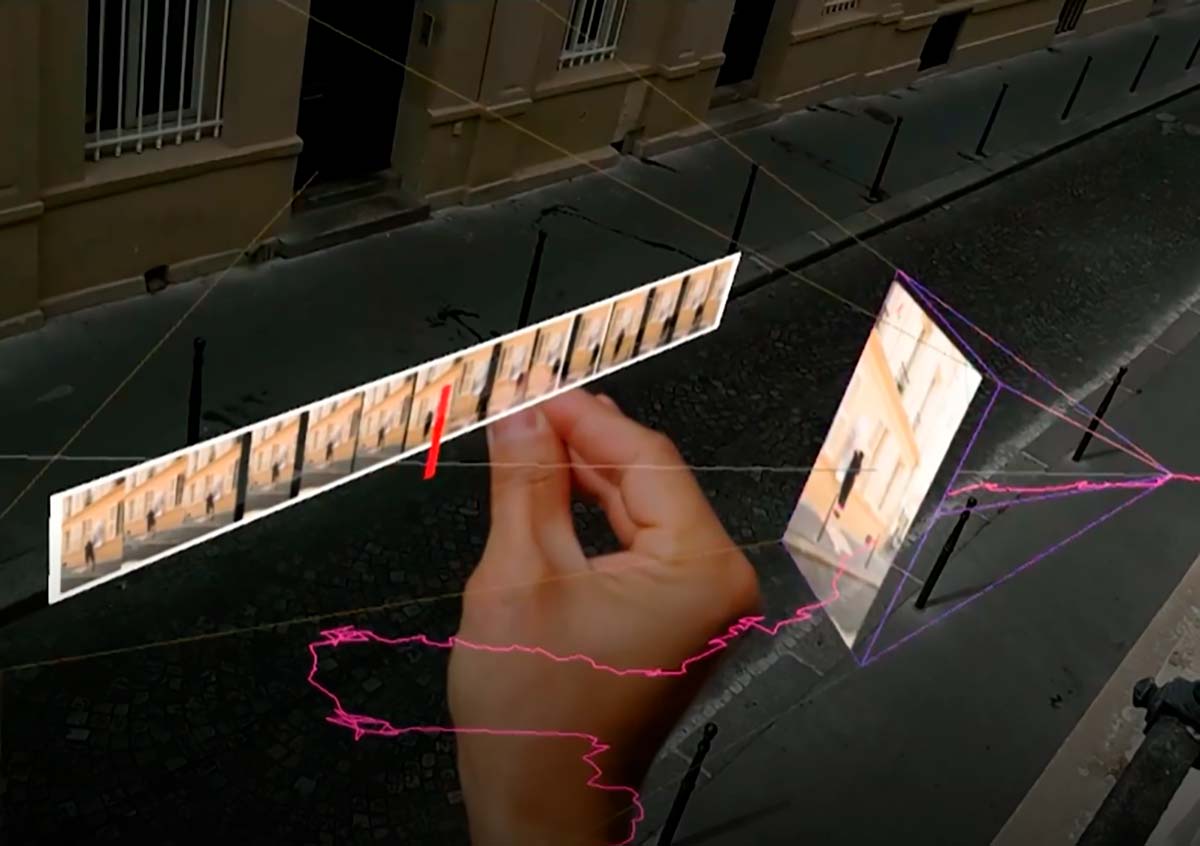

Combinar varias imágenes 2D en un entorno 3D

Verificar lo que realmente ocurrió durante un evento es una parte importante de la elaboración de información. Para facilitar el trabajo, el equipo de investigación diseñó un prototipo para que los reporteros vean piezas de medios (vídeos, fotos) procedentes del lugar donde fueron capturados. “Comparar imágenes de diferentes fuentes de esta manera podría ayudar a un reportero a identificar similitudes o unir una cronología de un evento en cuestión”, explican.

Para alinear videos 2D en un espacio 3D, confiaron en una técnica de visión por computadora llamada estructura a partir del movimiento. Este proceso permite reconstruir el camino de la persona que filma y una malla 3D del entorno grabado. Para este prototipo, los medios se alinearon manualmente y las escenas se reconstruyeron utilizando Reality Capture. El dispositivo de reproducción utilizado en este experimento fue Microsoft HoloLens, que permite a los usuarios ver modelos virtuales y videos superpuestos en el mundo real.

En el futuro, el uso de metadatos de geolocalización y orientación de la cámara tomados de los medios de origen podría ayudar a automatizar el proceso de reconstrucción, así como ayudar en la alineación con ubicaciones del mundo real, explican desde The NYT y añaden que se podrían agregar técnicas adicionales de aprendizaje automático para resaltar similitudes o discrepancias entre los archivos de medios encontrados.